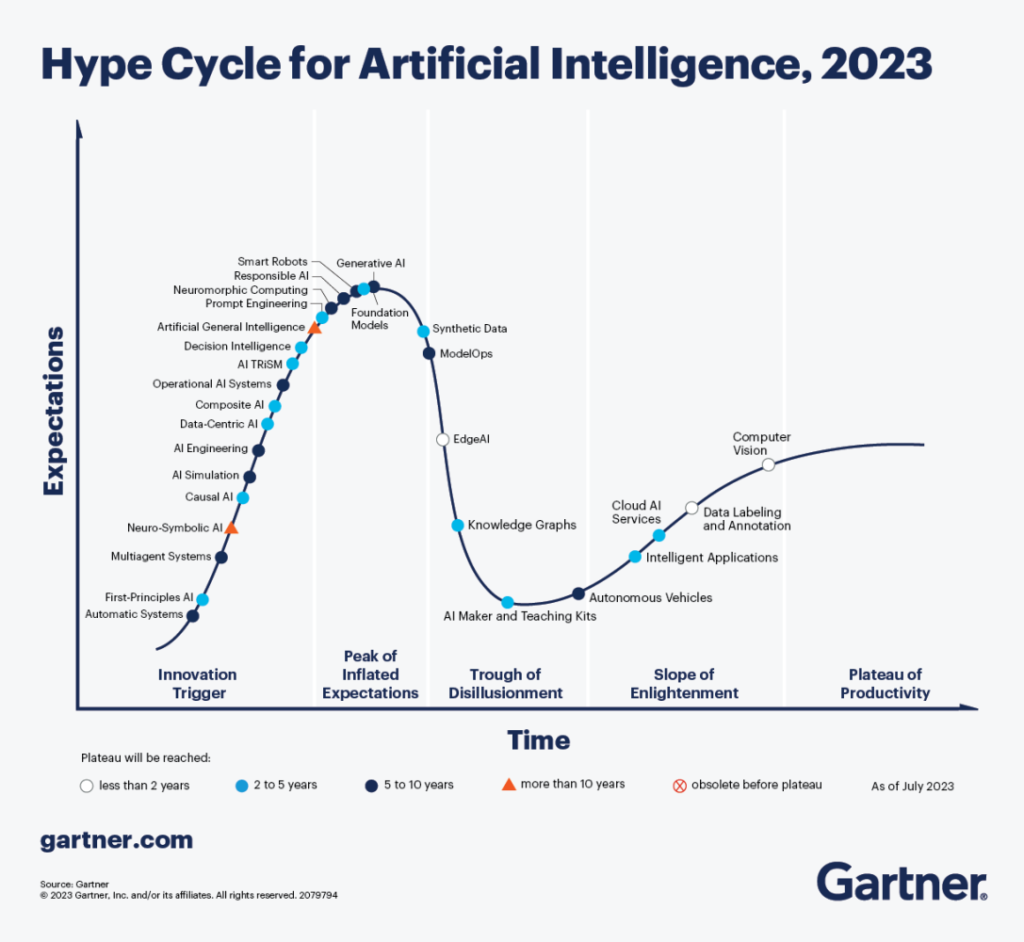

Negli ultimi anni, l’industria dell’intelligenza artificiale (IA) ha vissuto un’espansione vertiginosa, attirando investimenti massicci e catalizzando l’interesse di aziende e governi di tutto il mondo. Tuttavia, recenti analisi di Goldman Sachs, Elliott e Gartner stanno sollevando dubbi sull’efficacia pratica e la sostenibilità di questi strumenti, facendo emergere lo spettro di una possibile bolla finanziaria simile a quella delle dot-com degli anni Novanta. L’intelligenza artificiale, un tempo confinata nei romanzi di fantascienza, è ormai parte integrante della nostra quotidianità. Dagli assistenti vocali ai sistemi di raccomandazione (recommender system), l’IA permea ogni aspetto della nostra vita, promettendo di rivoluzionare settori chiave come la medicina, i trasporti e le comunicazioni.

L’ottimismo iniziale ha portato a una rapida crescita delle valutazioni delle aziende tech che operano in questo settore, spesso senza un corrispondente incremento dei risultati pratici e dei profitti. Goldman Sachs, Elliott e Gartner, nomi di rilievo nel mondo della finanza e della consulenza, hanno iniziato a esprimere scetticismo riguardo alla reale efficacia e applicabilità degli strumenti di intelligenza artificiale attualmente disponibili. Secondo questi analisti, molte delle promesse fatte dalle aziende tecnologiche potrebbero essere esagerate o irrealistiche, il che potrebbe portare a un drastico ridimensionamento delle aspettative e, di conseguenza, dei valori di mercato.

Le preoccupazioni degli analisti hanno avuto un impatto immediato sui mercati finanziari. Venerdì scorso, le borse europee e statunitensi hanno subito forti perdite, trascinate dal crollo delle azioni delle principali aziende tecnologiche coinvolte nello sviluppo e nell’implementazione dell’IA. Questo brusco calo ha ricordato a molti la crisi delle dot-com degli anni Novanta, quando l’eccessiva speculazione su Internet e le tecnologie emergenti portò al crollo di numerose società e a una significativa perdita di capitalizzazione di mercato.

La bolla delle dot-com degli anni Novanta fu caratterizzata da una corsa all’oro tecnologico, con investitori pronti a scommettere su qualsiasi azienda con una presenza online, indipendentemente dalla sua redditività o sostenibilità. Quando la realtà economica non riuscì a tenere il passo con le aspettative, il mercato collassò. Oggi, l’industria dell’IA sembra seguire un percorso simile, con molte aziende che ricevono valutazioni elevate basate su promesse futuristiche piuttosto che su risultati tangibili.

Se la bolla dell’IA dovesse davvero scoppiare, l’impatto sui mercati finanziari potrebbe essere significativo. Tuttavia, è importante ricordare che, nonostante il possibile ridimensionamento, l’intelligenza artificiale rappresenta comunque una tecnologia con un enorme potenziale di trasformazione. La chiave sarà una valutazione più realistica delle sue capacità e un approccio più prudente agli investimenti.

L’impiego sempre più diffuso dell’IA solleva una serie di interrogativi di natura etica. Uno dei più pressanti riguarda i bias algoritmici, ovvero le tendenze dei sistemi di IA a perpetuare e amplificare i pregiudizi presenti nei dati su cui sono addestrati. Ciò può portare a decisioni inique in ambito giudiziario, assunzioni e accesso ai servizi. Un altro tema cruciale è la privacy. La raccolta e l’analisi massiccia di dati personali, necessari per addestrare i modelli di IA, pongono seri interrogativi sulla tutela della privacy individuale. Come possiamo garantire che i nostri dati siano utilizzati in modo etico e trasparente?

L’autonomia delle macchine è un ulteriore aspetto da considerare. Man mano che i sistemi di IA diventano sempre più sofisticati, si pone la questione della responsabilità in caso di errori o danni causati da queste macchine. Chi è responsabile se un veicolo a guida autonoma provoca un incidente? Oltre alle questioni etiche, l’IA pone anche sfide significative in termini di sicurezza. Gli attacchi informatici ai sistemi di IA possono avere conseguenze disastrose, compromettendo infrastrutture critiche e mettendo a rischio la privacy di milioni di persone. L’uso dell’IA in ambito militare solleva preoccupazioni ancora più profonde. Lo sviluppo di armi autonome, capaci di prendere decisioni di vita o di morte senza intervento umano, pone seri interrogativi sulla nostra capacità di controllare le tecnologie che creiamo.

Nonostante le sfide, l’IA offre un potenziale enorme per migliorare la nostra vita. Grazie all’IA possiamo sviluppare nuovi farmaci, prevedere disastri naturali, e creare città più intelligenti e sostenibili. Per sfruttare al meglio le potenzialità dell’IA e mitigare i rischi ad essa associati, è fondamentale un approccio multidisciplinare che coinvolga esperti di tecnologia, etica, diritto e politica. Alcune azioni chiave includono:

- Sviluppo di algoritmi equi e trasparenti: è necessario garantire che i sistemi di IA siano progettati e addestrati in modo da evitare bias e discriminazioni.

- Tutela della privacy: è fondamentale rafforzare la normativa sulla protezione dei dati personali e garantire che le aziende utilizzino i dati in modo responsabile.

- Collaborazione internazionale: le sfide poste dall’IA richiedono una risposta coordinata a livello globale.

- Educazione e consapevolezza: è importante formare cittadini informati e consapevoli dei rischi e delle opportunità offerti dall’IA.

L’intelligenza artificiale rappresenta una delle più grandi rivoluzioni tecnologiche della nostra storia. Per sfruttare al meglio il suo potenziale, è fondamentale affrontare le sfide etiche e di sicurezza in modo proattivo e responsabile. Solo così potremo costruire un futuro in cui l’IA sia al servizio dell’umanità.

Digital Security Festival 2024: Navigando tra innovazione e etica per un futuro con l’IA!. Vi invitiamo a divenire partner, sostenitori e partecipanti al Digital Security Festival 2024, dove l’umanità incontra la tecnologia e il domani prende forma nelle nostre mani oggi!

Articolo pubblicato su LinkedIn